前篇分享 Ollama 在 Windows 上怎麼安裝以及如何切換模組( 前往複習:在 Windows 上安裝 Ollama),本篇來介紹在 Ollama 常用的指令。

在 2025/08/12 Ollama 官方更新版本後, Ollama 現在有自己內建的聊天 UI 視窗,安裝完畢後,就可以進行初步對話,不過在使用上會遇到一些更專業的問題時,需要進入命令提示字元(Command Prompt)來確定安裝內容,做環境上的調整。

本篇就以確認是否安裝成功來展示~進入命令指示字元時,會用到哪些常用指令。

本文索引

確認安裝是否成功

如果不開 Ollama UI 介面,如何確定自己有沒有安裝成功呢?

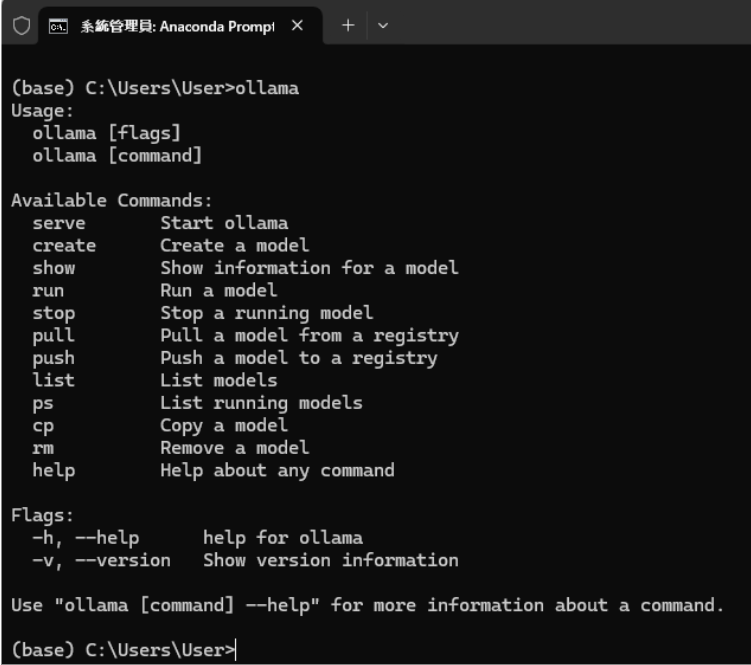

可以打開命令提示字元(Command Prompt),輸入指令 ollama,呼叫出相關指令。(在Windows的搜尋列輸入cmd)

- 在 Windows 的搜尋列,輸入 “cmd”

- 跳出命令指示字元的畫面後,輸入 “ollama”

出現下面的畫面就是成功囉!

常用指令

輸入 Ollama 之後,就會跳出常用指令,這邊用中文跟大家分享指令的功能與範例。

| 指令 | 功能 |

| 範例 | |

| serve | 啟動 Ollama 服務(伺服器模式),讓其他應用程式或 API 存取模型 |

| ollama serve | |

| create | 建立一個模型(通常需要指定模型配置檔) |

| ollama create mymodel -f ./Modelfile | |

| show | 顯示模型的詳細資訊(大小、版本、配置等) |

| ollama show llama2 | |

| run | 執行一個模型(啟動對話) |

| ollama run llama2 | |

| stop | 停止正在運行的模型 |

| ollama stop llama2 | |

| pull | 從 Ollama 官方下載模型但不執行 |

| ollama pull llama2 | |

| push | 將本地模型上傳到資料庫(需要帳號與權限) |

| ollama push mymodel | |

| list | 列出本地已安裝的模型 |

| ollama list | |

| ps | 顯示當前正在運行的模型 |

| ollama ps | |

| cp | 複製一個模型到新的名稱 |

| ollama cp llama2 llama2-copy | |

| rm | 刪除本地模型 |

| ollama rm llama2 | |

| help | 顯示指令的說明 |

| ollama help run |

安裝模型

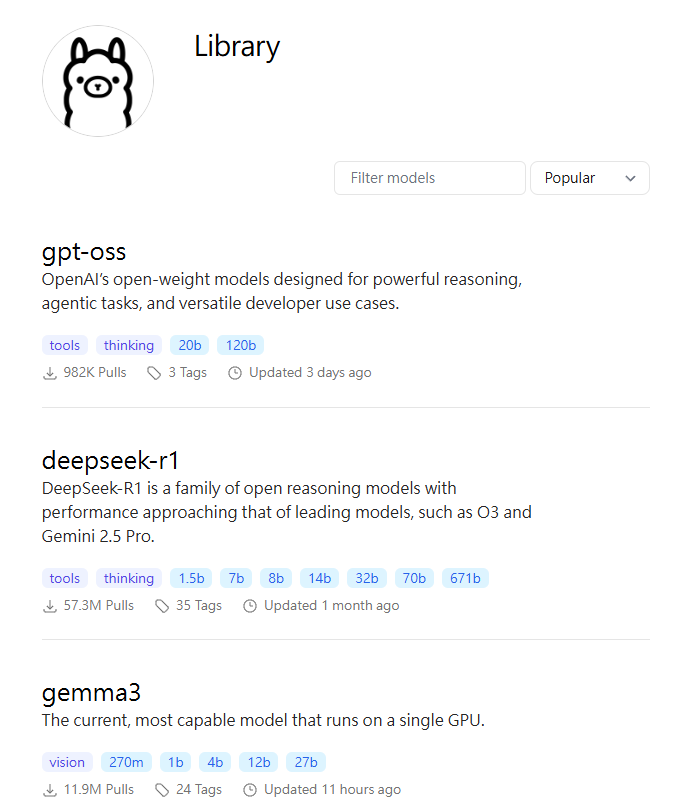

在上篇文章安裝完成後,可以在 Ollama UI 介面選擇需要的模型,如果沒找到想要的模型,可以到 Ollama 官方網站(https://ollama.com/library)找符合你需求的模型來使用。

網站上每個模型都有介紹,內容包含了模型有幾種大小(如:gpt-oss 有 20b 和 120b )、是否有思考鏈(thinking)、有多少人下載或是最後更新是什麼時候等等⋯⋯。

看到想要下載的模型,有兩個方式可以安裝:

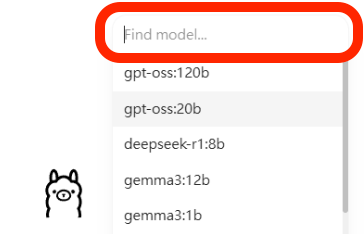

- 在 Ollama 的聊天介面中用 find model 搜尋。

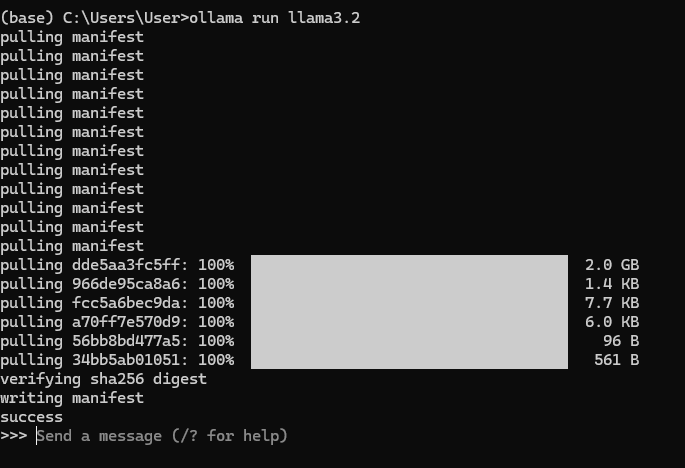

- 使用指令 ollama run + model name 進行下載。舉例:ollama run llama3.2

等待安裝後,下方出現 success 就可以在 Send a message 輸入問題開始對話(或是回到 Ollama UI 對話視窗開始聊天了)。

以上就是 ollama 的常用指令與指令介面怎麼使用的介紹,開始嘗試跟模型對話後,有其他想知道的內容與細節歡迎在下方留言。

我是陪你一起在下班後繼續被 AI 追著跑的冠軍,我們下篇文章見。

安裝教學|串接-GitHub-之-Copilot.001.jpeg)